作者:趙精武,北京航空航天大學法學院助理教授,工業與信息化法治戰略與管理重點實驗室辦公室主任,北京科技創新中心研究基地研究員,華東政法大學數字法治研究院特聘研究員。

摘 要:深度學習算法的創新和實踐為決策者提供規避風險和效率優化的可視化預測,以此為基礎的人臉識別技術正在重新塑造已有的社會生產方式,但技術本身的不成熟以及外部的安全風險也在增加人臉識別技術應用的不穩定因素。《民法典》首次回應了社會所關注的“個人信息”保護問題,完成了“理性人”向信息人”的過渡,但卻未能回應人臉識別信息不可更改性和人格權益屬性所提出的特殊保護需求。面對刷臉支付、人臉搜索等應用實踐的持續深入以及“杭州人臉識別第一案”對司法審判提出的新問題, 方面,司法栽判者需要在《民法典》既有體例下重新解釋“知情同意”等具體規則的適用方式;另一方面,在“回應型法”導向下,立法者需要在行政法規和部門規章層面確立生物特征識別信息的特殊保護規則。

關鍵詞:人臉識別信息;人臉識別技術;知情同意;信息控制論;損害賠償

一、問題的提出

刷臉支付、刷臉進出等人臉識別技術應用縮短了以往人工身份核驗的繁瑣程序,“人臉”毋庸置疑地成為“陌生人社會”框架下信賴重構的重要工具。不過,正所謂“正復為奇,善復為妖”,信息技術的頻繁迭代在推進數字化社會進程的同時,也増加了數據泄露、隱私侵犯等諸多不確定因素。盡管中國《民法典》《網絡安全法》《數據安全法(征求意見稿)》等諸多規范性文件已經確認了自然人對個人信息所享有的民事權益,但問題在于,數據安全和信息權益的場景化屬性遠超傳統的民事法律客體,尤其在確定“數據分級分類管理”的基本方向之后,個人信息保護的語境分析趨勢愈發明顯。倘若繼續沿用功利主義立場的技術行政管制模式,勢必會僵化技術與法律之間的互動關系,故而有必要重新審視人臉識別技術應用所產生的的法律問題。繼美國學者諾內特和塞爾茲尼克提出“壓制型法”“自治型法”之后,法律已經處于“回應型法”的發展階段。所謂“回應”,既是指向現有的法律現實和社會現實,地是指向實用主義的實質正義觀。人臉識別技術作為一種客觀的技術現象,自身并非是法律意欲調整和規范的直接目標,該項技術在應用過程中所形成的新型民事法律關系才是法律所亟需回應的實質內容。

人臉識別信息作為人臉識別技術的直接產物,其內在的人格權益屬性顯而易見,但該項人格權益的內涵與外延、實現方式等具體內容卻無從尋之。誠然,《民法典》在“民事權利”一節中規定了“自然人的個人信息受到法律保護”,在人格權編中也規定了一般個人信息的保護規則。然而,這些規定在適用過程中仍然存在諸多疑問:自然人對人臉識別信息相關事項的“知情”范圍如何認定?信息控制者如何在公共場所獲得自然人對面部數據采集和處理的“同意”?“優化用戶產品體驗”“保障其他用戶安全”等理由能否構成信息處理者處理人臉識別信息的免責事由?

二、人臉識別技術的應用場景與風險定位

(一)人臉識別技術的應用場景

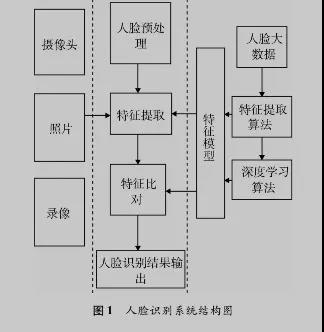

雖然現行立法并未對“人臉識別技術”的內涵和外延作出界定,但學界普遍認同該項技術屬于身份核驗的生物識別技術,通過“自動定位、跟蹤采集、比對提取、分離存儲”等人臉特征信息處理環節完成錄人數據與人臉數據庫的關聯比對,最終指向特定自然人。還有學者進一步將人臉識別技術的應用模式總結為和“1對N”的人臉識別,進一步細化該項技術的內在結構。所謂“1對1”的人臉驗證,是指通過比較被識別對象的人臉信息和庫存模板中的人臉信息,以判定兩張人臉是否屬于同人,其廣泛應用于微信、支付寶的購物支付程序;智能門禁的刷臉認證程序等;而“1對N”的人臉識別,則是指通過對比被識別對象的臉部信息與集中數據庫中存儲的多個模板信息來辨識身份,其廣泛應用于安防檢查、疑犯追蹤、照片自動圈人等領域。例如,沃爾瑪超市正在開發能夠檢測識別顧客面部表情的人臉識別信息系統,通過攝像機記錄下顧客從排隊到結賬過程的面部表情和體態動作,以此評估和解決顧客對服務的不滿。相較于其他生物識別技術,此類技術具有無接觸、交互性強、高效迅速、符合人類識別習慣等優勢,且能夠廣泛應用于身份驗證、安全監控、接入控制、人機交互等領域,場景化應用特征明顯。

在金融領域,人臉識別技術應用主要包括安全防控和業務優化兩類。在安全防控場景下,人臉識別技術的應用涵蓋了銀行從現金押運到前臺業務辦理各個環節,在現金押運、保險柜黃金放置等環節, 存在綜合門禁卡、指紋驗證、人臉識別和密碼驗證等多個驗證方式,確保核心業務工作人員身份驗證的準確性與唯一性。在日常經營活動中,銀行分支機構通過營業大廳攝像頭采集、存儲、分析短期人員來往,通過后臺與公安信息系統的連接,能夠有效識別可疑人員,如反復“踩點”、面部遮擋較多以及可能脅迫他人取款等危險人群。在使用自助取款機、自助終端機辦理個人業務時,人臉識別技術的應用方式表現為“1對1”的人臉驗證,確保辦理業務的卡主與銀行信息系統留存信息一致,避免盜刷。在業務優化領域,《中國人民銀行關于改進個人銀行賬戶服務加強賬戶管理的通知》第一項中明確支持在核驗身份信息環節,“有條件的銀行可探索將生物特征識別技術和其他安全有效的技術手段作為核驗開戶申請人身份信息的輔助手段”,銀行消費者在遠程辦理開設個人賬戶時,可通過人臉識別信息系統等多重身份驗證技術手段縮減線下辦卡的諸多不便。例如,在中國農業銀行研發的“超級柜臺”業務模式中,針對日常個人業務中常出現的銀行卡掛失補辦、重置遺忘的密碼等問題,該行以“網點初審身份、軟件識別人臉、后臺復核身份”的三重風控措施實現業務效率與業務安全的兼顧。

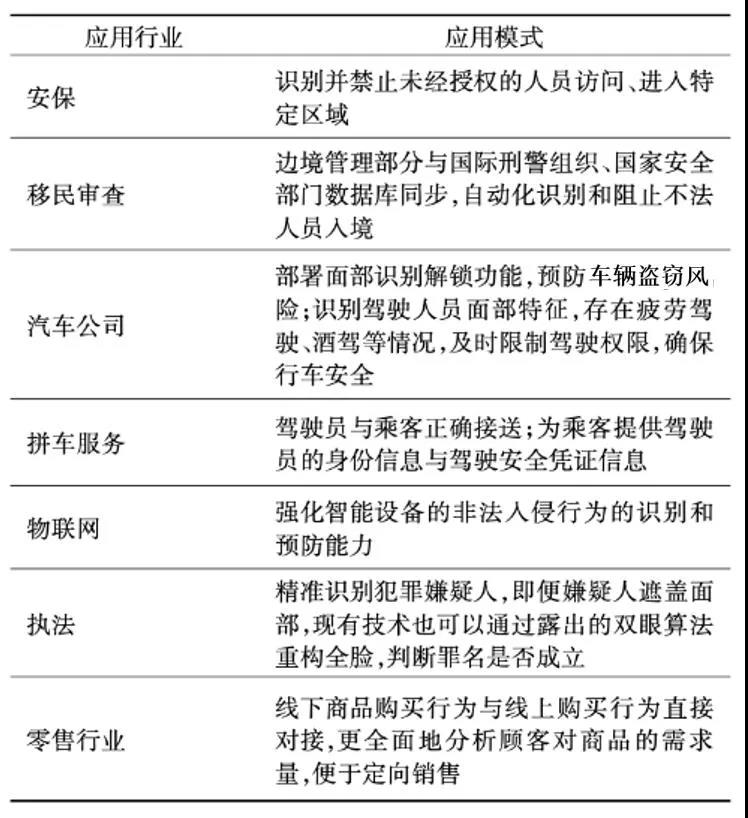

在現階段,人臉識別技術的實用功能早已不再局限于智能終端用戶解鎖等基礎業務,而是伴隨著市場精細化程度的深入,其應用領域呈現縱深化趨勢,如表1所示。有觀點認為當今人臉識別技術的應用基本可分為“安全應用”“醫療保健”“產品服務營銷”三大領域:“安全應用”是指通過深度學習算法識別欺詐行為,減少對密碼驗證的依賴性;“醫療保健”是指通過利用人臉表情特征的識別,準確跟蹤病患的藥物消耗與疼痛感知狀況;“產品服務營銷”則是指人臉識別技術對個性化服務的優化將服務對象從“特定偏好人群”進一步精確到“滿足面部特征的特定個體”。

表1 國外人臉識別技術的應用場景

(二)人臉識別技術的風險定位:隱私、主體平等與技術獨裁

從立法目的來看,立法規制始終離不開對技術損害合法權益的實踐問題總結,規制人臉識別技術需要審視場景化視野下該類技術的法律風險與損害權益的具體表現形式。總結刷臉支付、出人口刷臉識別、智能設備解鎖等場景下人臉識別技術的應用模式,如前文所述,大致可分為“1對1”“1對N" 兩種識別模式,前者是為了驗證“A是否是真的A”,后者則是為了驗證“A到底是誰”。人臉識別技術的法律風險主要集中于“1對N”模式,因為前者僅是特定自然人面部特征數據的簡單比對,無需比對該自然人的姓名、住址、電話等具體身份信息,屬于單純的身份核驗;而后者則需要通過大量的人臉數據錄入形成深度學習訓練集合來完成特定自然人的精準定位,其識別過程既包括特定自然人的面部特征識別,也包括特定自然人身份信息的關聯比對,以此來實現如何“排他性”地解釋“A究竟是誰”。在歐盟,人臉數據采集受到嚴格限制,歐盟委員會在《人工智能戰略白皮書》( White Paper on Artificial Intelligence—a European Approach to Excellence and Trust)中提及歐盟正在考慮是否限制政府部門和私營機構在公共場所使用攝像頭收集生物識別信息并識別個人身份,不過諸如使用面部圖像解鎖設備等安全身份驗證的應用模式并不在限制范圍內。從國內外技術實踐來看,人臉識別技術所存在的社會風險主要表現為三類:其一,隱私侵犯風險。即無論該項技術以何種方式融入具體的信息服務中,都無法擺脫對人臉生物特征數據庫的依賴。唯有對通過數據庫所形成的深度學習訓練集合進行關聯比對才能完成身份驗證這一基礎功能,而數據庫所存儲的各類信息往往直接關涉到自然人的年齡、健康狀況、情緒波動等個人私密信息,潛在的網絡安全威脅直接影響到用戶個人隱私保護。其二,主體平等風險。即人臉識別技術在具體業務中往往與社會信用系統、公安系統等社會公共服務信息系統相互連接,借由對收人和購物行為的分析,信息技術可能直接對特定人群標識“警惕”的標簽,尤其在國外商場、超市購物場景下,低收入黑人群體可能直接成為治安管理的重點對象。其三,技術濫用風險。在國外,人臉識別監控往往被視為“公權力濫用”的征兆,反對警察采集人臉信息的活動并不鮮見。也有學者將此種技術濫用風險總結為“技術獨裁風險”,因為人臉識別信息的采集與使用通常以社會公共利益和國家安全為例外情形,在國家治理現代化過程中,過度依賴人臉識別技術對社會公共空間的監視,以“技術權威”取代“政府權威”,不免存在服務型社會向管制型社會倒退的問題。

國外立法者普遍將人臉識別技術視為一種高風險技術應用,美國舊金山、加州奧克蘭以及波土頓禁止在市區使用人臉識別技術,其原因大多認為該項技術仍處于發展階段,尚未形成具體的技術安全標準,容易造成對公民隱私權的侵犯,并且在公共場所使用人臉圖像采集與監控也存在歧視風險,容易引發高危人群的劇烈反抗。不過,這些禁令大多是與政府部門在公共場所監控直接相關,智能設備人臉解鎖等安全身份驗證并不在此列。2019年,美國國會議員至少提出過六個限制人臉識別技術使用的法案,都均未形成實際的立法文件。盡管人臉識別技術存在諸多法律風險,但美國立法者仍然采取審慎態度監管該項技術的實際應用,即便在之前的提案中,對人臉識別技術應用的限制也極為有限。例如,參議院提出的“2019年人臉識別技術許可法案”(S.2878)對該項技術的限制僅以追蹤個人物理位置超過三天的“進行中的監管”為限。相較于美國,中國現行立法對人臉識別技術的行政監管與私法規范尚存在空白,結合人臉識別技術的信息系統構成和數據處理流程來看,以信息安全風險為核心的法律風險存在于從人臉數據采集到人臉數據關聯比對的信息處理全生命周期。在人臉數據收集階段,信息處理者需要收集用戶的人臉圖像,其渠道主要包括攝像頭采集、照片和錄像上傳等方式。該階段的法律風險主要表現為信息處理者以何種方式采集才能滿足中國現有立法規范,《網絡安全法》第41條和《民法典》第1035條規定收集個人信息時需要經過權利人同意,并且告知權利人處理個人信息的方式、范圍和目的,但現有的人臉數據采集方式除了通過智能設備終端的攝像頭掃描采集之外,還有可能通過用戶協議、訪問權限設置等方式來獲取用戶人臉數據,在公共場所的人臉數據采集以及網絡平臺公開照片的人臉數據采集似乎難以在實踐層面尋求每一個自然人的“同意”。并且,人臉識別技術的應用不僅僅需要對用戶個體的人臉數據收集,在“1對N”的模式下更需要海量的人臉數據形成數據比對庫,用于面部特征的提取,這也就導致信息處理者往往會抓取大量公開照片進行深度學習。這種數據采集方式顯然未經特定自然人的明確同意,并且中國現行立法亦未承認在網絡公開照片等于默示同意商業化使用照片,信息處理者可能陷入侵犯個人信息權益的泥沼之中。在人臉數據分析(包括眼睛定位、膚色像素化)、存儲、更新等處理環節,《網絡安全法》第42條和《民法典》第1038條要求信息處理者應當采取必要措施確保個人信息安全,加之人臉識別信息的敏感性,信息處理者在設計人臉識別信息系統時,勢必需要考慮如何規避數據泄露、損害或丟失等問題。進一步而言,由于人臉識別信息的高度敏感性,一旦發生數據泄露等數據安全事件時,除非致損原因表現為現有技術水平無法應對、第三方網絡攻擊等形式、未履行《數據安全法(征求意見稿)》第27條規定的數據安全保護義務外,信息處理者極有可能面臨以人格權益受損為由的集體索賠。在人臉識別信息維護、更新階段,信息處理者若未能及時更新存在內容偏差的人臉識別信息,且該人臉識別信息關聯的信息服務對特定自然人產生重大影響時,構成對《民法典》第1037條規定的“更正權益”的損害。

三、技術治理的法理基礎: 人臉識別信息的法律屬性

(一)人臉識別信息保護的必要性與特殊性:從“杭州人臉識別第一案”談起

人臉識別技術本身并沒有社會評價層面的好壞之分,之所以亟需立法回應,是因為伴隨著該項技術開發和應用的縱向深入,其目的不再局限于對被識別者臉部生理特征進行識別,而是將人的臉部信息與其個人身份、偏好、位置、財產等信息鏈接,進行分析比對獲得其他關聯信息。依據《網絡安全法》第76條關于個人信息的定義,人臉識別技術中的人臉信息能夠與其他信息相結合而具有高度可識別性,因此人臉信息的基本性質為“可識別的個人信息”,且其一旦被泄露、非法收集或者不正當地使用,則會對信息主體的個人名譽、身心健康造成嚴重損害甚至使信息主體受到歧視性的待遇,因此人臉信息可以被依法納入“個人敏感信息”范疇。與其他個人信息相比,人臉信息具有不可更改性,人臉數據能準確、真實、無法更改地識別信息主體;人臉識別技術具有無接觸性,人臉信息的收集可以通過遠距離、無感知的方式實現,因此人臉信息濫用的安全隱患呈現高危性。

在“杭州人臉識別第一案”中,杭州野生動物世界在未與郭兵進行任何協商也未征得郭兵同意的情況下,以短信的方式告知郭兵“園區人園系統已經由指紋識別升級為人臉識別,未注冊人臉識別的用戶將無法正常入園”。待郭兵到園區核實后,短信的內容屬實,工作人員表示如果不進行人臉識別注冊將無法入園,也無法辦理退卡退費手續。郭兵認為,人臉識別所收集到的面部特征等個人生物識別信息屬于個人敏感信息,一旦泄露、非法提供或者濫用,將極易危害消費者人身和財產安全,野生動物世界未經原告的同意,變相強制收集原告個人生物識別信息,嚴重違反了《消費者權益保護法》第29條的規定,損害了原告的合法權益。由于該案發生在《民法典》頒布之前,故而仍需適用《合同法》《侵權責任法》《民法總則》等規定。從侵權糾紛的角度來看,盡管在《侵權責任法》第2條所羅列的“民事權益”范圍中并無“個人信息權”等表述,但《民法總則》第11條卻是規定了自然人對個人信息享有民事權益。動物園“脅迫式”收集人臉識別信息顯然構成對“不得非法使用、加工、傳輸個人信息”的違反。可問題在于庭審過程中,動物園主張人臉識別之目的是為了提升消費者入園效率且確實有效,那么這種另類的“消費者權益保護”能夠構成免責事由呢?此外,從《侵權責任法》第6條所規定的“過錯行為一損害”的立法模式來看,動物園的刷臉進入行為實難構成侵權法中的“過錯行為”,因為在刷臉支付的同時,動物園還允許年卡持有人每次入園時進行身份核驗,難以證成動物園之行為滿足侵權行為構成要件。從合同糾紛的角度來看,郭兵與動物園之間構成年卡服務合同(無名合同),動物園最初是以個人身份證、指紋為人園條件,但在之后變更為“刷臉進入”,實質屬于單方變更合同之行為,理應對購買年卡服務的郭兵不產生法律效力,其也有權要求動物園按照最初約定的方式入園。

國外同樣存在針對人臉識別技術的訴訟糾紛,如在近期二審宣判的“英國人臉識別第一案”中,原告訴稱在經過警察部署的面部識別(AFR)設備時,警察并未告知其正在使用AFR技術,依據《歐洲人權公約》《英國2018年數據保護法》等規定主張警察之行為構成對個人隱私的侵犯。而當地的警察部門則主張AFR設備部署地區具有明確的標識,且這些設備僅能識別警察“監視清單”上的危險人群,無法識別清單之外自然人的身份信息。英國上訴法院認為警方有權依法使用信息技術收集特定范圍的信息,但警察依據《英國2018年數據保護法》第64條所提供的“數據保護影響評估”相關文件未能正確評估AFR技術對數據主體權利的安全風險。上訴法院還指出AFR技術與其他信息技術的核心區別在于該項技術需要抓拍和采集英國公民的面部照片與數據,涉及個人敏感信息,當地警察部門所提供的證明材料未能直接說明清單監視人員范圍與AFR 設備部署地點選擇的正當性,亦未能證明其已經采取合理步驟評估該項技術可能存在的歧視問題。

(二)人臉識別信息的法律屬性

從私法的角度出發,人臉識別信息作為特殊類型的個人信息,《民法典》《網絡安全法》《數據安全法(征求意見稿)》等法律對其性質均有所涉獵,大抵是置于賦權式的個人信息保護規范框架下予以規定,或是以人格權解釋個人信息內在的人格利益屬性,或是以“交易”等表述承認人臉識別信息的財產屬性。事實上,在立法層面,意欲梳理人臉識別信息的法律屬性與規制方式,則仍應當以人臉識別信息的獨特性為規范起點,溯源該類信息的人格利益與財產利益在商業實踐中的表現形式。盡管學界有關人臉識別技術規制路徑的討論尚處于初步探索階段,但學者們普遍認可人臉識別信息具有不可更改性、可識別性、專屬性和直觀性。學者們認為,之所以需要通過立法干預和規制人臉識別技術的應用,原因在于人臉識別信息具有“直觀”地識別特定自然人的能力,一且與身份信息關聯比對,特定自然人難以采取有效措施徹底消除“識別可能性”,因而,通過法律規制人臉識別技術凸顯其必要性與合理性。誠然,這種高度識別能力正在蠶食自然人私密信息空間,使得個人在現實社會與網絡空間“無所遁形”,但這種特殊性的觀察視角卻是以靜態的信息類型為基礎,切斷了技術應用與信息結果之間的關聯性,同時也模糊了人臉識別信息與人臉數據兩個概念之間的差別。從刷臉支付、刷臉進出等具體的商業實踐來看,人臉識別信息的形成涉及人臉數據采集與錄人、人臉數據錄入與特征提取、人臉大數據與特征算法比對等諸多環節,人臉識別信息并不能簡單地等同于人臉生物特征的數據測量。人臉識別信息與人臉數據最大的差別在于“識別”之表述,單純以數字或字符形式存在的人臉數據僅僅只是對特定自然人面部輪廓的客觀表述,亦可理解為自然人肖像的數字化形式,而人臉識別信息則更強調通過人臉生物識別特征的不可更改性與對應自然人身份信息的關聯比對,通過設備端的圖像采集與數字化處理,驗證自然人的特定身份。然而,這種“識別性”亦不同于一般個人信息,后者的識別”能力如《民法典》第1034條所規定的,表現為單獨識別和結合其他信息識別兩種方式,而前者在未“綁定”對應自然人身份信息之前不具備可識別能力。即便該數據是特定自然人面部的數據集合,但這種“識別”實際上僅限于機器可讀層面的識別,對于自然人而言,絕無可能直接通過面部數據定位特定自然人身份。而利用不特定面部特征數據與特定自然人身份信息關聯的人臉識別技術則將傳統個人信息保護理念中的“可識別”轉換為精準識別和持續識別。所謂精準識別,是指人臉識別信息能夠精準地定位特定自然人,因為面部特征的絕對專屬性和直觀性導致識別對象錯誤的可能性微乎其微;所謂持續識別,則是指面部特征的不可更改性決定了人臉識別信息的識別能力不會因為行為人的日常行為模式劇變而失去,即使面部會衰老,但面部骨架結構、五官位置等基本衡量指標并不會改變,除非服務提供方取消人臉識別信息的關聯機制或者進行大幅度的面部整容,該類信息始終能夠定位特定的自然人。

這種精準且持續的識別能力在立法層面表現為人格利益在信息空間的異化與延伸。《民法典》第990條不僅明確了生命權、健康權、肖像權、隱私權等具體人格權利,同時還將以“人格自由”和“人格尊嚴”為基礎的其他人格權益納入保護范疇。從《民法典》對于人格權利的具體條款來看等權利”“人格利益”之表述在實質上確定了中國民法體系中人格權利保護的開放性。面對日趨豐富的民事社會實踐,守著傳統人格權利的“一畝三分地”不是對法律穩定性和權威性的維護,而是僵化了《民法典》民事權利的保護方式。有限的人格權利類型與復雜的侵權形式之間的緊張關系早已是不爭的事實,學者們也認為《民法典》意欲保護的不是特定的具體人格權,而是具備開放性的人格權益。在此背景下,人臉識別信息的可識別利益顯而易見是《民法典》所確認的信息空間人格權益,在權益性質層面,有學者在解釋自然人對個人信息享有民事權益這一命題時指出,信息處理活動始終屬于平等主體之間法律關系基本范疇;在權益性質的認定層面,有學者根據《民法典》人格權編草案(三次審議稿)指出,認定個人信息具備人格權益是以個人信息自決的兩項權能為基本規范框架,一是自我決定個人信息公開的諸多事項,二是自我決定個人信息處理的諸多流程。進一步而言,“人臉識別信息具備人格權益”的依據在于該類信息能夠直接影響到自然人對識別自身身份可能性的控制能力,無法實現信息空間中的“個人自由”。需要說明的是,自然人對人臉識別信息享有人格權益并不是承認存在所謂的“人臉識別信息權”。《民法典》未以“個人信息權”的形式確定新型人格權利的原因在于回避有關權益具化阻礙數據和信息自由流動的爭議。事實上,無論是“人臉識別信息權”,還是“個人信息權”,這些對個人信息權益的具體表達實際上并不重要,重要的是這些新型人格權益的內容與保護方式。同時,自然人對人臉識別信息享有人格權益并不排除信息處理者對人臉識別信息享有財產權益,因為人臉識別信息的形成需要信息處理者支付涉及面部特征提取算法、人臉數據采集、構建“人臉大數據”等信息處理環節的成本,這種“勞動支出”決定了人臉識別信息的保護方式不能以“完全限制”或“嚴苛限制”的方式為主,而是要在兩個層面強化對人臉識別信息的事前保護,避免因信息復制成本低廉和指數式傳播等基本特性導致的損害結果不可彌補:一是明確規范信息處理者在信息收集、比對、分析等處理環節的具體義務,明確人臉數據與特定自然人身份信息比對的必要性與合比例性;二是在承認信息處理者、控制者的經濟性支出的基礎上,細化人臉識別技術應用的合法標準和例外情形,包括用戶表示同意和撤回同意等實際方式。

四、人臉識別技術應用的修繕式解釋與填補式標準設計

(一)《民法典》第1035條的修繕式解釋

在現行立法框架下,人臉識別信息終究是“個人信息”的子概念,始終需要遵循個人信息保護的一般規則,“知情同意”理所當然地應當同樣適用于人臉識別信息保護。《民法典》第1035條所確立的“知情同意”要求信息處理者在處理個人信息時應當征得自然人或其監護人同意,并告知自然人有關信息處理的目的、方式和范圍等事項,但該規則在適用于人臉識別技術生成、處理人臉識別信息的過程中需要進一步完善“知情同意”的可操作性。在商業實踐中,如何在公共場合獲取自然人或其監護人“同意”、如何判斷自然人是否對人臉信息處理行為“知情”“同意”是否能夠撤回等問題直接影響到人臉識別技術的應用模式選擇,現有“知情同意”缺乏具體標準去衡量場景化視域下個人信息的保護。國內學界有關“知情同意”的討論大多也是圍繞“一般人理性知情”和“差異化知情”等判斷標準展開論述,有觀點認為基于信息社會的復雜性,“同意”的適用方式隨著個人信息類型的變化而有所偏移, “同意”是“知情”的決策結果,且內容應當是具體內容,而非概括式同意。還有學者主張知情同意的本質為“風險分配”,通過用戶協議等方式以“同意授權”重構自然人與信息處理者之間的信賴關系。從個人信息保護實踐來看,知情同意原則的局限性是客觀存在的,通過“同意”來實現充分的信息自決或意思自治僅是立法所追求的理想法益狀態,該項制度在商業實踐中已經演變為信賴的重新建構,一方面,自然人通過知情同意原則建構起對信息處理活動的初步信賴;另一方面,信息處理者在遵守前述“信賴”內容的基礎上完成信息的自由流動。因此,需要明確的是,以“知情同意”規制人臉識別技術應用并非是苛求信息處理者支付一定的經濟成本完成權利保障,而是通過信息處理活動的規范化確保個人信息的合理使用。在此業務領域,立法所需要明確的是如何判斷信息處理者是否采取必要措施規避個人信息處理活動的安全風險和法律風險。例如,非政府部門及其委托機構在公共場所采集人臉圖像時,信息處理者應當以“醒目”的標識提醒自然人已經進入人臉圖像采集范圍;通過智能設備采集人臉圖像時,應當以字體加粗、高亮突出、授權同意等方式強化用戶對人臉圖像采集和人臉識別信息使用范圍的基本認知。除此之外,囿于專業知識有限、技術實現的可能性等諸多因素,用戶不可能對所有人臉識別信息的處理活動有著足夠且清晰的認知,法律法規所要規定的“同意”應當為一般理性人的概括式同意,即以一般理性人所能認知和預測的信息處理目的、范圍和方式為實際內容,至于部分學者所提出的逐項點擊“同意”信息處理行為,既不符合人臉識別技術的實踐現狀,也不符合用戶使用信息服務的習慣。

(ニ)人臉識別技術安全標準的“填補式”風險治理

在現代“風險社會”理論框架下,英國學者珍妮?斯蒂爾將貝克和吉登斯的“反思性現代性”特點總結為不良結果與決策的關聯深化,即出現預料之外的風險事件,人們側重于確定該事件背后的人為原因。信息技術創新所帶來的社會風險雖然同工業社會的“現代風險”均屬于人為引發的客觀風險,但前種風險因技術和人為因素的無序組合難以直接追求人為原因。即便通過法律法規苛以事前的法律義務來規避風險,何種限度的法律義務能夠兼顧風險最小化與產業發展兩種法益尚未可知,更遑論公法層面的直接監管。盡管刷臉支付、刷臉出入等技術應用模式已經相當普及,但這并不能說明人臉識別技術自身已經處于完全成熟的階段,相關的破解技術與安全問題同樣存在。當下,立法者所要明確的并非是人臉識別技術如何進行監管,而是如何明確與解釋圍繞人臉識別信息的權利義務關系,避免行政監管可能造成的技術創新枷鎖。當然,這并不意味著放棄監管,而是以技術標準的方式規范人臉識別信息的處理活動,形成行業內統一的行為規范降低新興信息技術的安全風險。同時,信息處理者是否遵循相應的行業標準也將成為司法審判中判斷責任歸屬之依據,技術引發的現代化風險也于此在信息處理者與自然人之間進行再次分配。技術標準與法律責任的關聯意味著技術標準自身需要以個人信息保護的“安全、合法、正當且必要”基本原則為核心理念,將人臉識別技術按照信息處理流程切割為人臉識別信息系統的代碼編寫與系統架構設計、人臉圖像的采集、人臉識別信息的關聯比對、人臉識別信息的更新、維護與刪除等諸多環節。在個人信息保護的早期研究中,“收集一分析一處理一存儲一刪除”式的全生命周期一直被學者們奉為圭桌,但如今值得質疑的是,基于信息全生命周期的規范內容是否能夠真正適用于信息處理實踐活動?在人臉識別技術應用中,安全風險的產生根源除了以往的數據挖掘、大數據分析等具體環節之外,還在于技術本身的不確定性。因此,在技術標準中,或許可以借鑒歐盟《通用數據保護條例》(GDPR)的經由設計的數據保護”思路,除了提供一般意義上的個人信息處理行為規范,強化人臉識別技術對個人信息安全的影響評估,包括人臉大數據建構的合規性評估、人臉識別技術更新的安全評估、人臉識別信息及其數據庫的更新維護評估等內容,盡可能在事前階段完成信息安全風險的最大化分散。例如,在人臉大數據的建構過程中,信息處理者應當評估人臉圖像數據來源的合法性,不得未經自然人同意擅自采集其人臉圖像。又如,集團公司應當對人臉識別信息的共享開放進行安全性和合規性評估,評估內部共享人臉識別信息和向政府部門共享人臉識別信息的安全性。這種評估并非無源之水,而是可以嵌入至《數據安全法(征求意見稿)》第四章“數據安全保護義務”中,既是第25條“開展數據活動應當依照法律、行政法規的規定和國家標準的強制性要求”的基本內容之一,也是第28條“重要數據的處理者應當按照規定對其數據活動定期開展風險評估”的應有之義。

五、余論

觀之個人信息保護的現有觀點與論證,或是以個人信息的權益內容為切口,或是在“信息主體信息控制者”的主體論范式下討論權益平衡,觀察視角不盡相同,但在法理層面,始終無法回避對技術中立難題的自覺性研究。在信息技術變革的浪潮下,沒有任何法律客體能夠“獨善其身”。法律對技術最合理的回應莫過于參與技術的重構過程,維系法律價值與技術價值的內在統一。《民法典》作為中國“承上啟下”的第一部法典,承接了既有的民事法律制度,同時也開啟了“信息民法”“綠色民法”的新道路。人臉識別技術作為諸多商業活動的主流技術架構,天然地具備民商法調整的必要性和優先性,如若將行政管制主義置于優先順位,只會促成行政監管對技術應用的制度東縛。自然人對人臉識別信息所享有的民事權益可從《民法典》第126條“其他民事權利和利益”尋求正當性基礎,這并非是數據時代“權利泛化”的表征,而是對《民法典》第1034條的合理解讀和延伸。在“后民法典”時代, 《民法典》立法工作重心已然轉向司法實踐中對具體條款的解讀與適用。進一步而言,司法機關所要面對的特殊個人信息絕非人臉識別信息只此一種, 健康醫療信息、未成年人身份信息等其他特殊個人信息同樣有賴于法院擴大解釋個人信息保護的具體規則。同時,借助技術安全標準等可操作性規范性文件補足“是否履行個人信息保護義務”的判斷標準,達成“經設計的信息保護”之法律效果。